संदर्भ:

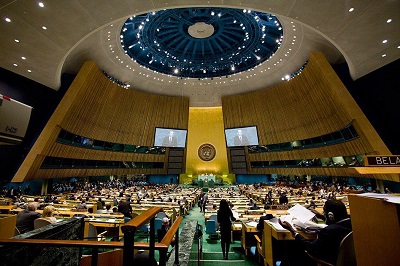

- विगत 7 मई 2024 को, यूरोप परिषद (CoE) ने स्ट्रासबर्ग में मंत्रिपरिषद की वार्षिक बैठक का आयोजन किया। इस बैठक के दौरान कृत्रिम बुद्धिमत्ता (AI) पर पहली बार बाध्यकारी रूप से अंतरराष्ट्रीय कानूनी संधि को अपनाकर एक ऐतिहासिक कदम उठाया। सम्मेलन की यह रूपरेखा कृत्रिम बुद्धिमत्ता प्रणालियों को उनके डिजाइन और विकास से लेकर उनके उपयोग और निष्क्रियता तक व्यापक रूप से विनियमित करने का लक्ष्य रखते हुए, कृत्रिम बुद्धिमत्ता, मानवाधिकारों, लोकतंत्र और कानून के शासन से जुड़ा है। हालांकि, संधि का विनियामक दृष्टिकोण और प्रामाणिक अस्पष्टता जवाबदेही और दायित्वों के बारे में महत्वपूर्ण सवालों को अनुत्तरित छोड़ देती है।

कृत्रिम बुद्धिमत्ता (AI) सम्मेलन की रूपरेखा

- अनुमोदन और दायरा : कृत्रिम बुद्धिमत्ता समिति (CAI) द्वारा दो वर्षों से अधिक समय तक समन्वित यह रूपरेखा सम्मेलन, 46 यूरोप परिषद सदस्य देशों और 11 गैर-सदस्य देशों को निजी क्षेत्र, नागरिक समाज और शिक्षा जगत के प्रतिनिधियों को एक साथ लाता है। यह संधि गैर-यूरोपीय संघ देशों के लिए हितकारी है और जोखिम-आधारित दृष्टिकोण में यूरोपीय संघ के कृत्रिम बुद्धिमत्ता अधिनियम के समान है। इसका उद्देश्य सार्वजनिक और निजी दोनों क्षेत्रों में कृत्रिम बुद्धिमत्ता के उपयोग को विनियमित करना है, जिसमें सार्वजनिक क्षेत्र की ओर से कार्य करने वाली कंपनियां भी शामिल हैं।

- उद्देश्य और सिद्धांत: यह संधि समानता, गैर-भेदभाव, निजता और लोकतांत्रिक मूल्यों के सिद्धांतों के साथ संरेखित कृत्रिम बुद्धिमत्ता के जिम्मेदार उपयोग को बढ़ावा देती है। यह संपूर्ण कृत्रिम बुद्धिमत्ता जीवनचक्र को विनियमित करता है और निजी क्षेत्र के लिए दो अनुपालन विधियों को निर्दिष्ट करता है: सम्मेलन के प्रावधानों का पालन करना या अंतरराष्ट्रीय मानवाधिकार दायित्वों को पूरा करने के लिए वैकल्पिक उपाय करना। इस रूपरेखा कार्यान्वयन में लचीलेपन का लक्ष्य रखा गया है, ताकि विभिन्न तकनीकी, क्षेत्रीय और सामाजिक-आर्थिक स्थितियों को समायोजित किया जा सके। इसके लिए आवश्यक कार्यों, जैसे कि रोक या प्रतिबंधों को निर्धारित करने के लिए जोखिम आकलन की आवश्यकता होती है। इसके अलावा एक स्वतंत्र निरीक्षण तंत्र और सुधारात्मक उपायों को भी अनिवार्य किया जाता है।

जोखिम-आधारित विनियमन और प्रामाणिक अस्पष्टताएं:

- कृत्रिम बुद्धिमत्ता विनियमन में चुनौतियाँ : कृत्रिम बुद्धिमत्ता को विनियमित करना पारंपरिक विनियमन क्षेत्रों, जैसे बाजार प्रथाओं या भौतिक बुनियादी ढांचे से काफी अलग है। कृत्रिम बुद्धिमत्ता मशीन लर्निंग, कंप्यूटर विजन और न्यूरल नेटवर्क सहित प्रौद्योगिकियों की एक विस्तृत श्रृंखला को शामिल करती है, जो लगातार विकसित हो रही हैं। जोखिम-आधारित विनियमन का लक्ष्य, सख्त नियमों को लागू करने के बजाय संभावित नुकसानों पर प्रवर्तन को लक्षित करके विनियामक संसाधनों और प्रशासनिक शक्ति को अनुकूलित करना है। इसमें जोखिम मूल्यांकन, जोखिमों और अवसरों के बीच व्यापार को संतुलित करना और जोखिम स्वीकार्यता के लिए सीमाएं निर्धारित करना भी शामिल है।

- प्रामाणिक अस्पष्टताएं : जोखिम सहनशीलता और प्रामाणिक नियमों के व्याख्यात्मक अनुप्रयोग पर भिन्न दृष्टिकोणों से प्रामाणिक अस्पष्टताएं उत्पन्न होती हैं। ये अस्पष्टताएं अनुपालन के प्रवर्तन में बाधा उत्पन्न कर सकती हैं, खासकर जब कृत्रिम बुद्धिमत्ता के विकास और उत्पादन की वैश्विक, अंतरराष्ट्रीय प्रकृति से जुड़ी हों। डेटा और कंप्यूटिंग शक्ति जैसे महत्वपूर्ण कृत्रिम बुद्धिमत्ता संसाधनों का असमान वितरण, हितधारकों का विविध पारिस्थितिकी तंत्र और प्रणालीगत जोखिमों का गतिशील उद्भव विनियमन को और जटिल बनाते हैं।

कार्यान्वयन और अनुपालन

- लचीला कार्यान्वयन : इस संधि का लचीला कार्यान्वयन दृष्टिकोण, विभिन्न क्षेत्रों में विविध तकनीकी, क्षेत्रीय और सामाजिक-आर्थिक स्थितियों को स्वीकार करता है। इस लचीलेपन के लिए निरंतर जोखिम आकलन की आवश्यकता होती है, ताकि उभरते जोखिमों का समाधान किया जा सके और विनियामक उपायों को तदनुसार समायोजित किया जा सके। हालांकि, यह दृष्टिकोण विभिन्न क्षेत्राधिकारों में विनियमन की निरंतरता और प्रभावशीलता के बारे में भी सवाल उठाता है।

- स्वतंत्र निरीक्षण और समाधान : एक स्वतंत्र निरीक्षण तंत्र की स्थापना संधि का एक महत्वपूर्ण घटक है। यह निकाय अनुपालन की निगरानी, जोखिमों का आकलन और यह सुनिश्चित करने के लिए जिम्मेदार है कि कृत्रिम बुद्धिमत्ता प्रणालियाँ संधि के सिद्धांतों का पालन करती हैं। इसके अतिरिक्त, संधि कृत्रिम बुद्धिमत्ता प्रणालियों के कारण हुए नुकसानों के समाधान के लिए उपचारात्मक और निवारण उपायों को अनिवार्य करती है। हालांकि, दायित्वों और जवाबदेही के स्थानों पर स्पष्ट दिशानिर्देशों का अभाव व्यावहारिक कार्यान्वयन और प्रवर्तन के लिए चुनौतियां उत्पन्न करता है।

समस्याएं और अनुत्तरित प्रश्न

- जवाबदेही और दायित्व : इस संधि के साथ एक प्रमुख समस्या जिम्मेदारी और दायित्व को स्पष्ट रूप से परिभाषित करने में इसकी विफलता है। बड़ी प्रौद्योगिकी कंपनियों द्वारा प्रभुत्व वाला जटिल वैश्विक एआई पारिस्थितिकी तंत्र असमान शक्ति गतिकी और जटिल परस्पर निर्भरता संरचनाएं बनाता है। दायित्व की प्रकृति को उजागर करने और नियामक उपायों को लागू करने के लिए इस पारिस्थितिकी तंत्र के भीतर विभिन्न हितधारकों; आपूर्तिकर्ताओं, उपभोक्ताओं और मध्यस्थों की भूमिकाओं को पहचानना और निर्दिष्ट करना आवश्यक है। हालांकि, वर्तमान ढांचा इन मुद्दों को अपरिभाषित छोड़ देता है और नियामक नवाचार की जिम्मेदारी व्यक्तिगत हस्ताक्षरकर्ता देशों को सौंपता है।

- भागीदारी और वैधता : सम्मेलन की वैधता पर भी गैर-यूरोप परिषद सदस्य देशों की मसौदा तैयार करने और परामर्श प्रक्रिया में सीमित भागीदारी के कारण सवाल उठाए गए हैं। यह बहिष्कार संधि के वैश्विक स्वीकृति और प्रभावशीलता को प्रभावित कर सकता है। संभावित हस्ताक्षरकर्ताओं को 5 सितंबर, 2024 तक अनुपालन की घोषणाएं प्रस्तुत करने की आवश्यकता है, जो व्यापक राष्ट्रीय एआई कानून और विनियमों का मसौदा तैयार करने के लिए एक छोटा बदलाव समय है।

भविष्य के सिफारिशें:

- गतिशील जटिलता का समाधान: भविष्य के सम्मेलनों और रूपरेखाओं को कृत्रिम बुद्धिमत्ता चालित प्रणालियों और पारिस्थितिकी तंत्रों की गतिशील जटिलता को स्वीकार करने की आवश्यकता है। कृत्रिम बुद्धिमत्ता पारिस्थितिकी तंत्र में परस्पर क्रिया करने वाली प्रणालियाँ और घटक शामिल होते हैं जिनके परिणामस्वरूप जटिल व्यवहार उभर कर आता है, जिसके लिए नए अंतःक्रियाओं और पर्यावरण में परिवर्तन के लिए निरंतर अनुकूलन की आवश्यकता होती है। प्रभावी प्रबंधन और अनुपालन प्रणालियों को दायित्वों के इर्द-गिर्द कानूनी सवालों का समाधान करना चाहिए और कृत्रिम बुद्धिमत्ता पारिस्थितिकी तंत्र में विभिन्न हितधारकों के लिए स्पष्ट जिम्मेदारियों को परिभाषित करना चाहिए।

- दायित्व व्यवस्था: यूरोपीय विशेषज्ञ समूह द्वारा 2019 की सिफारिश में उत्पाद दायित्व व्यवस्था का उपयोग करने का सुझाव दिया गया था, जिसमें मुकदमेबाजी के लिए एकल प्रवेश बिंदु के रूप में कृत्रिम बुद्धिमत्ता से संबंधित जोखिम को प्रबंधित करने में सबसे सक्षम इकाई को जिम्मेदारी सौंपना शामिल है। हालांकि, संधि विभिन्न दायित्व व्यवस्थाओं को अपनाने के लिए दिशानिर्देश निर्दिष्ट नहीं करती है, जिससे हस्ताक्षरकर्ताओं पर दायित्वों की प्रकृति निर्धारित करने का दायित्व आ जाता है। यह प्रभावी विनियामक उपायों को डिजाइन करने के लिए कृत्रिम बुद्धिमत्ता चालित प्रणालियों के सामाजिक, आर्थिक और कानूनी निहितार्थों को समझने के लिए व्यापक और विचारशील दृष्टिकोणों की आवश्यकता को रेखांकित करता है।

निष्कर्ष:

- कृत्रिम बुद्धिमत्ता (AI) पर पहली कानूनी रूप से बाध्यकारी अंतरराष्ट्रीय संधि को अपनाकर यूरोप परिषद का कदम कृत्रिम बुद्धिमत्ता के शासन में एक महत्वपूर्ण प्रयास है। यह रूपरेखा सम्मेलन कृत्रिम बुद्धिमत्ता को व्यापक रूप से विनियमित करने का प्रयास करता है, जो मानवाधिकारों, लोकतंत्र और कानून के शासन के अनुरूप जिम्मेदार उपयोग को बढ़ावा देता है। हालांकि, इसका जोखिम-आधारित विनियामक दृष्टिकोण और प्रामाणिक अस्पष्टताएं स्पष्ट जिम्मेदारियों और दायित्वों को परिभाषित करने में चुनौतियां उत्पन्न करती हैं। संधि की लचीली कार्यान्वयन रणनीति और स्वतंत्र निरीक्षण तंत्र महत्वपूर्ण घटक हैं, फिर भी दायित्वों और देयताओं पर स्पष्ट दिशानिर्देशों की कमी व्यावहारिक लागू करने और प्रवर्तन में बाधा उत्पन्न करती है।

- उपर्युक्त चुनौतियों का समाधान करने के लिए भविष्य के सम्मेलनों को कृत्रिम बुद्धिमत्ता पारिस्थितिकी तंत्रों की गतिशील जटिलता को पहचानने, हितधारकों की भूमिकाओं को स्पष्ट रूप से परिभाषित करने और मजबूत दायित्व व्यवस्था स्थापित करने की आवश्यकता है। कृत्रिम बुद्धिमत्ता के बहुआयामी निहितार्थों को समझने और कृत्रिम बुद्धिमत्ता प्रौद्योगिकियों के विकसित होते परिदृश्य के अनुकूल हो सकने वाले प्रभावी विनियामक ढांचे विकसित करने के लिए अंतर्राष्ट्रीय समुदाय को व्यापक और विचारशील दृष्टिकोणों में शामिल होना चाहिए।

|

यूपीएससी मुख्य परीक्षा के लिए संभावित प्रश्न:

|

स्रोत - ओआरएफ